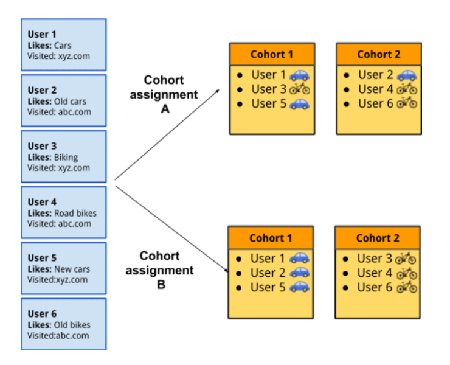

No dia 30 de março último, o Google lançou o “teste de origem” do Federated Learning of Cohorts – Aprendizagem Federada sobre Grupos (que tem o acrônimo inglês FLoC), sua nova tecnologia experimental para segmentação de anúncios. Um comando foi dado em Mountain View, California, e um switch foi silenciosamente acionado em milhões de instâncias do Google Chrome mundo afora: esses navegadores começarão agora a classificar seus usuários em grupos (Cohorts) com base em seu comportamento pessoal, compartilhando os rótulos desses grupos com rastreadores e terceiros anunciantes. Um conjunto aleatório de usuários foi selecionado para o teste, e a eles só foi dada a opção de desativar os cookies de terceiros no navegador.

Embora o Google tivesse anunciado previamente que isso iria acontecer, a empresa até agora foi esparsa em detalhes sobre o teste. Nós bisbilhotamos posts de blogs, listas de discussão, projeto de padrões da Web e o código-fonte do Chromium para tentar descobrir exatamente o que está acontecendo.

A EFF (Electronic Frontier Foundation) já escreveu que o FLoC é uma ideia terrível. O lançamento desse teste pelo Google – sem aviso prévio aos indivíduos que farão parte, muito menos seu consentimento – é uma violação concreta da confiança do usuário, e para completar, a serviço de uma tecnologia que não deveria sequer existir.

Abaixo descrevemos como esse teste funcionará e alguns dos detalhes técnicos mais importantes que soubemos até agora.

Começamos com a decepcionante observação de que o FLoC deveria originalmente substituir os cookies. No teste, ele os complementará.

O Google projetou o FLoC para ajudar os anunciantes a dirigir ao alvo seus anúncios quando os cookies de terceiros desaparecerem no futuro. Contudo, durante este teste, os rastreadores continuarão capazes de coletar, além dos IDs dos FLoCs, os cookies de terceiros.

Isso significa que todos os rastreadores que atualmente já monitoram o comportamento do caro leitor em uma parte da Web usando os cookies, agora vão receber adicionalmete seu IDentificador de grupo gerado pelo FLoC. O ID de grupo é um reflexo direto do seu comportamento em toda a Web. Ele pode complementar os perfis comportamentais dos usuários, o que muitos rastreadores já mantêm.

Foi divulgado que o teste foi originalmente distribuído para 0,5% dos usuários do Chrome em algumas regiões – por enquanto, isso significa a Austrália, Brasil, Canadá, Índia, Indonésia, Japão, México, Nova Zelândia, Filipinas e os EUA. Os usuários nessas regiões serão escolhidos de maneira completamente aleatória, independentemente das configurações de anúncio e privacidade do navegador. Somente usuários que desativaram cookies de terceiros no Chrome serão excluídos.

Além disso, a equipe por trás do FLoC solicitou que o Google aumente a amostra de 0,5 para 5% dos usuários, para que as empresas de tecnologia possam treinar melhor os modelos de Machine Learning usando os novos dados. Se essa solicitação for acatada, dezenas ou centenas de milhões de usuários adicionais serão incluidos no teste. Os usuários foram inscritos no teste automaticamente. Ainda não há como optar por não participar.

Versões futuras do Chrome adicionarão controles dedicados para isto que o Google chama de “Sandbox de Privacidade”, que inclui o FLoC. Mas não é claro quando essas configurações serão lançadas. Assim, por ora os usuários que desejam desligar o FLoC só podem fazê-lo desativando os cookies de terceiros.

Desligar os cookies de terceiros não é uma má ideia em geral. Afinal, esses cookies estão no centro dos problemas de privacidade que o Google diz que quer resolver. Mas desligá-los completamente é uma contramedida bruta, que quebra muitas conveniências (como logon único) nas quais os usuários da Web confiam. Usuários do Chrome conscientes sobre privacidade geralmente empregam ferramentas mais direcionadas, incluindo extensões, como o Privacy Badger, para evitar o rastreamento baseado em cookies. Infelizmente, as extensões do Chrome ainda não são capazes de controlar se um usuário expõe um ID de FLoC. Os sites também não estão sendo solicitados a optar.

O FLoC computa um rótulo de grupo com base no histórico de navegação. Para o teste, o Google vai usar os sites que servem anúncios – isto é, a maioria dos sites na web. Os sites podem optar por ser incluídos em computações de FLoC enviando um cabeçalho HTTP, mas alguns provedores de hospedagem não fornecem aos clientes controle direto sobre os cabeçalhos de seus sites. Muitos proprietários de sites provavelmente não estão cientes do teste.

Isso é um problema porque significa que os sites perdem controle sobre como os dados dos visitantes serão processados. Na prática atual, um administrador de site tem que tomar uma decisão deliberada de incluir o código de um anunciante em sua página. Os sites geralmente podem, pelo menos em teoria, optar por fazer parceria com anunciantes para gerar receita, limitados pelas suas políticas de privacidade. Contudo, agora, informações sobre a visita de um usuário a um site serão embrulhadas em seu ID do FLoC, que será amplamente disponíbilizado pela web (mais sobre isso na próxima seção). Mesmo que um site tenha uma forte política de privacidade e relacionamentos com anunciantes responsáveis, uma visita pode afetar como os rastreadores o vêem em outros contextos. O ID do FLoC de cada usuário – o rótulo que reflete seu histórico de navegação da semana passada – estará disponível para qualquer site ou rastreador que o quiser.

Qualquer um pode se inscrever nesse teste de origem do Chrome. Depois de cadastrado, pode-se acessar os IDs dos FLoCs dos usuários que foram escolhidos para o teste. Isso inclui o vasto ecossistema de anunciantes sem nome ao qual seu navegador se conecta sempre que você visita a maioria dos sites. Se você faz parte do teste, dezenas de empresas podem obter o ID de FLoC de cada site que você visita. Haverá mais de 33.000 grupos possíveis.

Uma das porções mais importantes da especificação do FLoC que ficou indefinida é exatamente quantos grupos existem. O Google fez um experimento preliminar empregando IDs de grupo de 8 bits, o que significa que havia apenas 256 grupos possíveis. Isso limitava a quantidade de rastreadores que poderiam saber o ID de grupo de um determinado usuário.

No entanto, um exame mais recente do Chrome revela que a versão ao vivo do FLoC usa identificadores de grupos de 50 bits. Os grupos são então juntados em lotes de 33.872 grupos, 100 vezes mais do que no primeiro experimento do Google. O Google disse que isso vai garantir que “milhares de pessoas sejam juntadas em cada grupo, de forma a que ninguém possa ser identificado individualmente”. Mas os IDs de grupo ainda vão expor muitas informações – cerca de 15 bits – e vão dar um grande peso a ítens biométricos, como impressões digitais.

O Google prometeu adotar salvaguardas para que os grupos não estejam muito correlacionados com “categorias sensíveis” como raça, sexualidade ou condições médicas. Para monitorar isso, o Google planeja coletar dados sobre quais sites são visitados por usuários em cada grupo. O teste provavelmente durará até julho. O Google liberou um whitepaper descrevendo como será sua abordagem.

Fico feliz em ver uma proposta específica, mas o Whitepaper dá um jeito de contornar os problemas mais prementes. A questão que o Google devia perguntar é: “Podemos, eticamente, segmentar grupos vulneráveis?”; O white paper reduz isso para “Podemos segmentar as pessoas que visitaram um site específico?”. Esta é uma simplicação perigosa. Em vez de trabalhar no problema difícil, o Google escolheu se concentrar em uma versão mais fácil que acredita poder resolver. Enquanto isso, não está conseguindo endereçar os graves potenciais problemas do FLoC.

Durante o teste, qualquer usuário que tenha ativado “Chrome Sync” (deixando o Google coletar seu histórico de navegação), e que não tenha desabilitado nenhuma das várias configurações de compartilhamento padrão, compartilhará o ID de grupo ligado ao seu histórico de navegação..

Na tentativa de mitigar essa potencial intrusão, o Google irá então verificar se cada usuário visitou quaisquer sites que considere parte de uma “categoria sensível”. Por exemplo, o WebMD poderá ser rotulado na categoria “Médica”, ou o Pornhub na categoria “Adulto” (ambas sensíveis). Se muitos usuários em um grupo visitaram um tipo específico de site “sensível”, o Google obfuscará esse grupo. Quaisquer usuários que fizerem parte de grupos “sensíveis” serão colocados em um grupo “vazio” (na tentativa “proteger” esses usuários por obfuscação). É claro que os rastreadores ainda poderão ver que os referidos usuários fazem parte do grupo “vazio”, revelando que, logo, eles eram originalmente classificados como do grupo “sensível”.

Para o teste de origem, o Google está recorrendo ao seu enorme tesouro personalizado de dados de navegação. No futuro, o Google planeja usar outra tecnologia (não especificada) de preservação de privacidade para fazer a mesma coisa sem acessar o histórico de navegação dos indivíduos.

Independentemente de como o Google faz isso, esse plano não resolverá os maiores problemas com FLoC: discriminação e segmentação predatória. A proposta repousa sobre a suposição de que as pessoas em “categorias sensíveis” visitarão sites específicos “sensíveis”, e que as pessoas que não estão nesses grupos não visitarão esses sites. Mas o comportamento humano se correlaciona com a demografia de maneira não intuitiva. É altamente provável que certas demografias visitem um subconjunto diferente da web do que outras demografias, e que tal comportamento não seja capturado pelo simples enquadramento de “sites sensíveis” do Google. Por exemplo, pessoas com depressão podem exibir comportamentos de navegação semelhantes, mas não necessariamente algo explícito e direto, como, por exemplo, visitar o site “depression.org”. Enquanto isso, as empresas de rastreamento são bem equipadas para reunir o tráfego de milhões de usuários, vinculá-lo a dados sobre demografia ou comportamento e decodificar quais grupos estão ligados a quais traços sensíveis. O sistema do Google, conforme proposto, não tem como parar isso.

O Google poderia fazer a escolha de desmantelar os antigos andaimes da vigilância sem substituí-los por algo novo e unicamente prejudicial. O Google não conseguiu abordar de verdade os possíveis danos do FLoC, ou mesmo nos convencer de que esses danos podem ser abordados. Em vez disso, ele está levando a cabo um teste que compartilhará novos dados sobre milhões de usuários desavisados. Este é outro passo na direção errada.

Fonte: Electronic Frontier Foundation – Licença Creative Commons