A estimativa de projetos é uma arte hermética, em nenhum lugar isso é mais verdadeiro do que no desenvolvimento de sistemas computacionais. Certa vez, ouvi falar de uma misteriosa confraria de numerólogos, que multiplicavam suas estimativas de tempo por π. A prática supostamente dava a eles uma margem de segurança suficiente para definir novos requisitos, testes, iteração e outras mudanças aleatórias no escopo do projeto.

Isso me pareceu curioso e arbitrário, mas fiquei intrigado. Depois de refletir um tanto, pude colocar a conjectura da estimativa circular (CEC) em bases matemáticas sólidas.

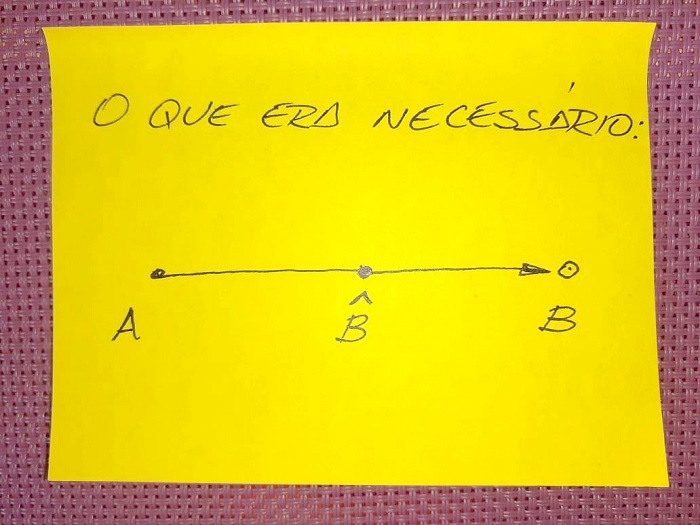

Alguém – um designer, seu líder, o produtor executivo, um amigo, sua mãe – pede que você faça algo. Você pensa um pouco, faz algumas anotações, considera o que é necessário e apresenta um projeto e uma estimativa de tempo para a conclusão.

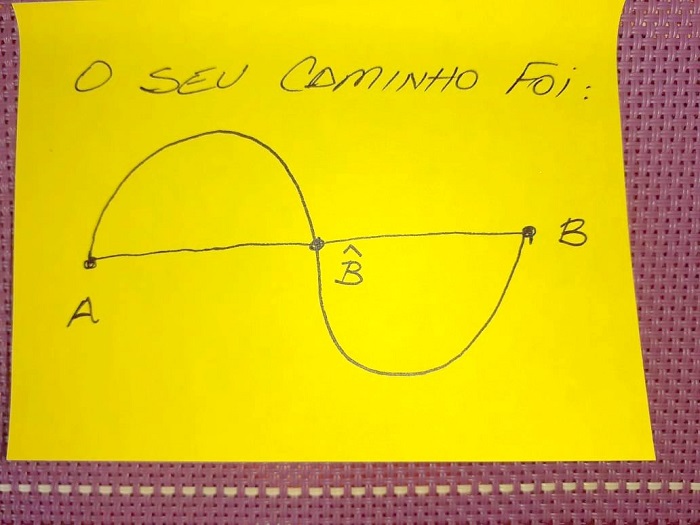

Mas as coisas mudam. Acontece que havia algumas coisas que seu designer/ líder/produtor/ amigo/mãe esqueceu de mencionar e, à medida que você fazia o trabalho, sugiram algumas ideias para estender o projeto um pouco mais. Seu escopo cresceu.

E é claro que nem tudo correu bem. Sua primeira tentativa foi um fracasso [instrutivo]. Então você focou na segunda tentativa e acabou criando uma serie de problemas que demoraram um tanto mais para serem ajustados. Você gastou dois dias extras para encontrar uma solução alternativa. Em suma, você seguiu um caminho positivamente tortuoso até seu objetivo.

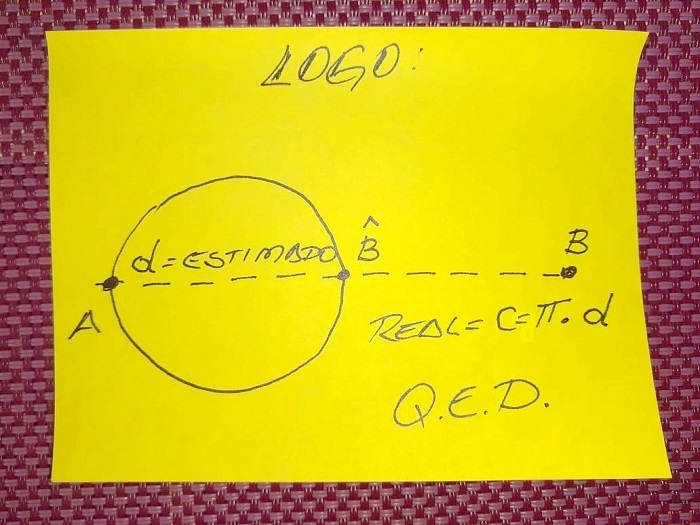

Quanto tempo demorou a sua jornada em comparação com o plano original? Parece que os numerólogos estavam certos…

E aí está – não importa o que você pense quando começa um projeto. Depois de passar pela pesquisa, design, discussões, protótipos, falhas, testes, rotatividade de requisitos e todos os outros caprichos do processo criativo, você certamente terá gasto π vezes o tempo que você planejou originalmente.

Alguns podem questionar meu rigor matemático e até mesmo contestar o que acredito ser a conclusão incontestável. Alguém poderá alegar que o multiplicador correto não é de fato π – mas 2, ou √2, ou e, ou a razão áurea φ. No entanto, não conheço ninguém que chegue a alegar que o multiplicador seja < 1.

Independentemente de quaisquer inclinações numerológicas, o argumento é que você se permita admitir que no início de um projeto você a) não tem o panorama completo, b) você não sabe como as coisas vão se encaminhar, e c) há trabalho pela frente sobre coisas que você ainda não tem ideia.

Nenhuma quantidade de planejamento e análise de tarefas pode mudar isso, então não tente. Em vez disso, dê a si mesmo uma reserva de tempo plausível e então mergulhe no trabalho.

Ah, e aquela lista de tarefas que você fez no fim de semana passado? Não é por acaso que você conseguiu concluir apenas cerca de um terço dos itens da lista. ;-)